Meskipun model kecerdasan buatan dapat berinteraksi dengan perangkat lunak melalui Application Programming Interface (API) yang terstruktur, banyak tugas digital sehari-hari yang masih menuntut interaksi langsung dengan antarmuka pengguna grafis. Tugas-tugas seperti mengisi dan mengirimkan formulir online, mememerlukan AI agent untuk bernavigasi, mengeklik, mengetik, dan menggulir halaman web atau aplikasi persis seperti yang dilakukan manusia. Kemampuan untuk mengoperasikan elemen interaktif dan bekerja di balik login merupakan alur kerja yang harus diperhatikan dalam membangun AI agent yang membantu mengerjakan tugas.

Google merilis Gemini 2.5 Computer Use model yang merupakan inovasi untuk membantu karyawan melakukan tugas-tugasnya. Model baru ini dibangun di atas kapabilitas pemahaman visual dan penalaran dari Gemini 2.5 Pro. Fungsi utamanya adalah menggerakkan agent yang mampu berinteraksi dengan antar muka pengguna. Model ini tersedia dalam mode preview melalui Gemini API dan dilaporkan mengungguli alternatif terkemuka lainnya pada beberapa benchmark kontrol web dan mobile dengan latensi yang lebih rendah.

Mekanisme Kerja AI Agent Google Gemini

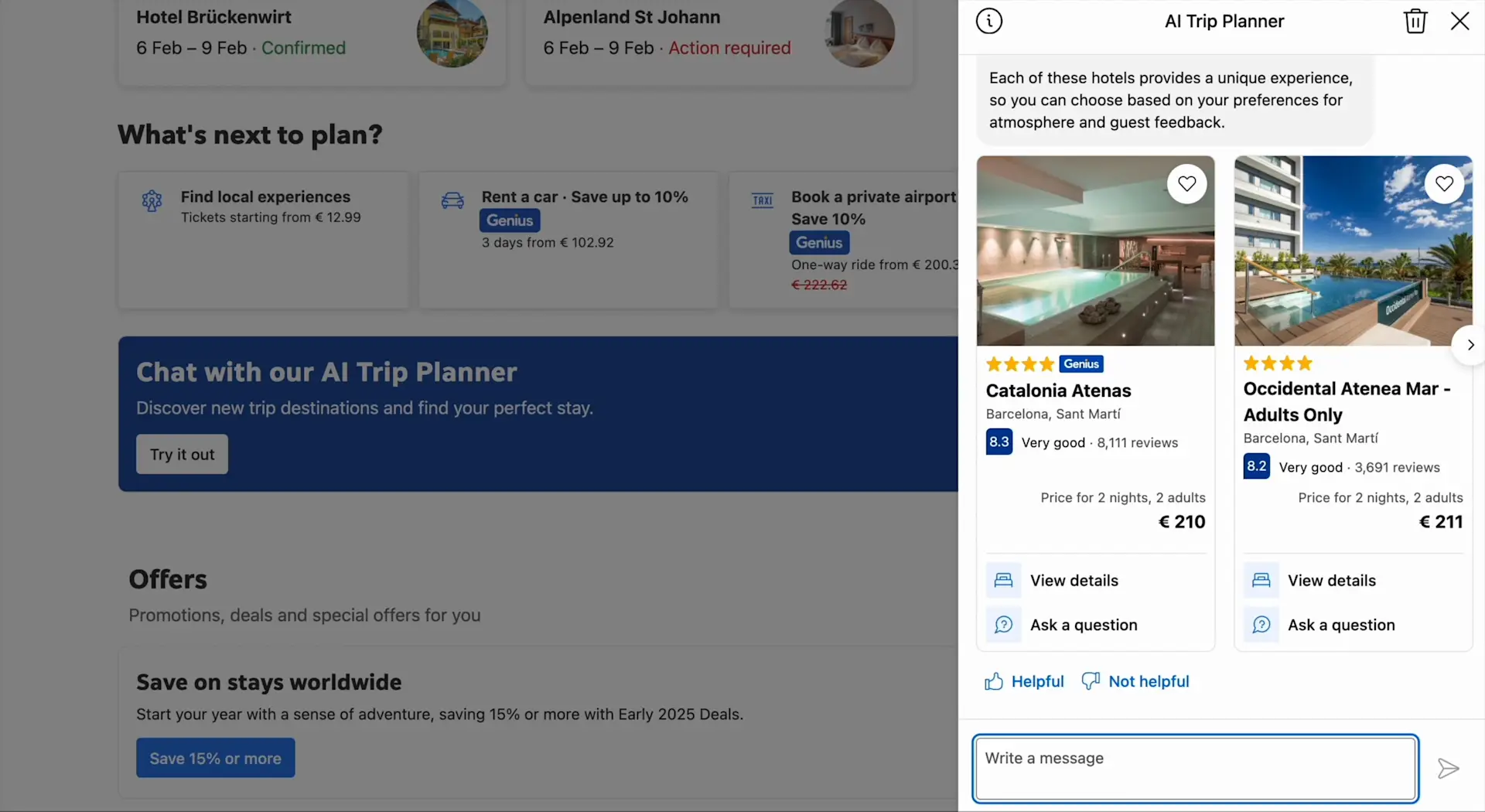

Kapabilitas model ini berjalan melalui tool baru bernama computer use di Gemini API dan harus dioperasikan dalam sebuah loop. Input yang diberikan kepada tool ini mencakup permintaan pengguna, screenshot lingkungan antar muka, dan riwayat tindakan terbaru. Model kemudian menganalisis input ini dan menghasilkan respons, yang biasanya berupa panggilan fungsi yang mewakili salah satu tindakan antar muka, seperti mengeklik atau mengetik.

Proses ini bersifat iteratif. Setelah tindakan dieksekusi oleh kode dari sisi client, screenshot baru dari GUI dan URL dikirim kembali ke Gemini 2.5 Computer Use model sebagai respons fungsi, yang kemudian memulai kembali loop atau pengulangan tersebut. Proses ini berlanjut hingga tugas selesai, terjadi kesalahan, atau interaksi dihentikan oleh respons keamanan atau keputusan pengguna.

Salah satu fungsi pentingnya adalah memberikan permintaan konfirmasi kepada pengguna akhir, yang diwajibkan untuk tindakan tertentu, misalnya ketika akan melakukan pembelian. Langkah ini memastikan bahwa pengguna tetap memiliki kontrol dan menyadari tindakan yang berisiko tinggi. Meskipun model ini dioptimalkan terutama untuk browser web, model ini juga menjanjikan untuk tugas kontrol antar muka mobile.

Risiko AI Agent

Google menyadari bahwa AI agent yang mengontrol komputer menimbulkan risiko unik, termasuk potensi penyalahgunaan yang disengaja, perilaku model yang tidak terduga, dan serangan prompt injection atau penipuan di lingkungan web. Oleh karena itu, penerapan pengaman keamanan menjadi penting.

Google melatih fitur keamanan secara langsung ke dalam model untuk mengatasi tiga risiko utama tersebut. Selain itu, Google juga menyediakan kontrol keamanan tambahan bagi pengembang untuk mencegah model menyelesaikan secara otomatis tindakan yang berpotensi berisiko tinggi atau berbahaya.

Kontrol keamanan ini memiliki dua fungsi utama:

- Per step safety service: Layanan keamanan waktu inference di luar model yang menilai setiap tindakan yang diusulkan model sebelum tindakan tersebut dieksekusi.

- System instructions: Pengembang dapat lebih lanjut menentukan bahwa agent harus menolak atau meminta konfirmasi pengguna sebelum mengambil jenis tindakan berisiko tinggi tertentu.