Google memperkenalkan generasi terbaru Tensor Processing Unit (TPU) untuk mempercepat pengembangan dan operasional AI skala besar.

Kebutuhan komputasi untuk AI terus meningkat, terutama untuk sistem yang mampu berpikir, merencanakan, dan belajar secara mandiri. Model AI tidak lagi hanya menjalankan perintah, tetapi bekerja dalam siklus berkelanjutan yang mencakup penalaran hingga eksekusi.

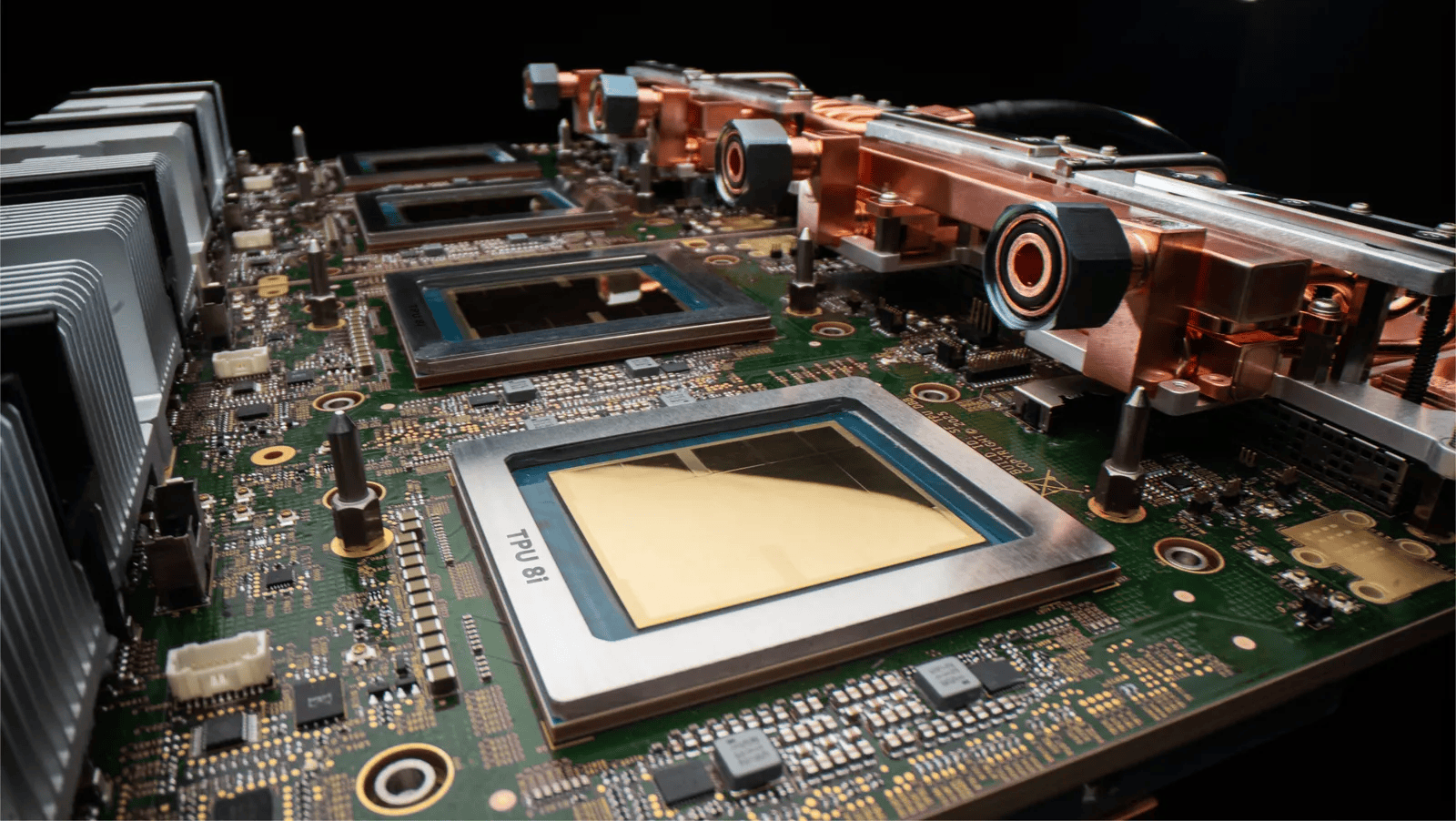

Melihat fungsi AI yang makin berkembang, Google merilis generasi terbaru Tensor Processing Unit yang dirancang untuk dua fungsi utama, yaitu pelatihan model dan eksekusi inferensi. Pendekatan ini memisahkan beban kerja agar performa tetap optimal di setiap tahap.

Pengembangan chip ini dilakukan dengan pendekatan co-design antara perangkat keras dan perangkat lunak. Strategi ini memastikan bahwa setiap komponen saling terintegrasi dan mampu menghasilkan performa tinggi dengan konsumsi energi yang lebih terkontrol.

TPU 8t yang difokuskan untuk pelatihan model dirancang sebagai mesin komputasi berkapasitas sangat besar. Sistem ini memungkinkan proses yang sebelumnya memakan waktu berbulan-bulan dapat dipercepat menjadi hitungan minggu.

Beberapa kemampuan utama pada sistem pelatihan ini meliputi:

- Kemampuan menghubungkan ribuan chip dalam satu cluster komputasi terintegrasi

- Dukungan memori sementara hingga skala petabyte untuk menangani dataset besar

- Performa komputasi hingga tingkat exaflops untuk model AI kompleks

Selain performa, sistem ini juga dilengkapi mekanisme monitoring otomatis yang berjalan tanpa henti. Jika terjadi gangguan pada salah satu komponen, sistem dapat mengalihkan beban kerja secara real time tanpa menghentikan proses pelatihan.

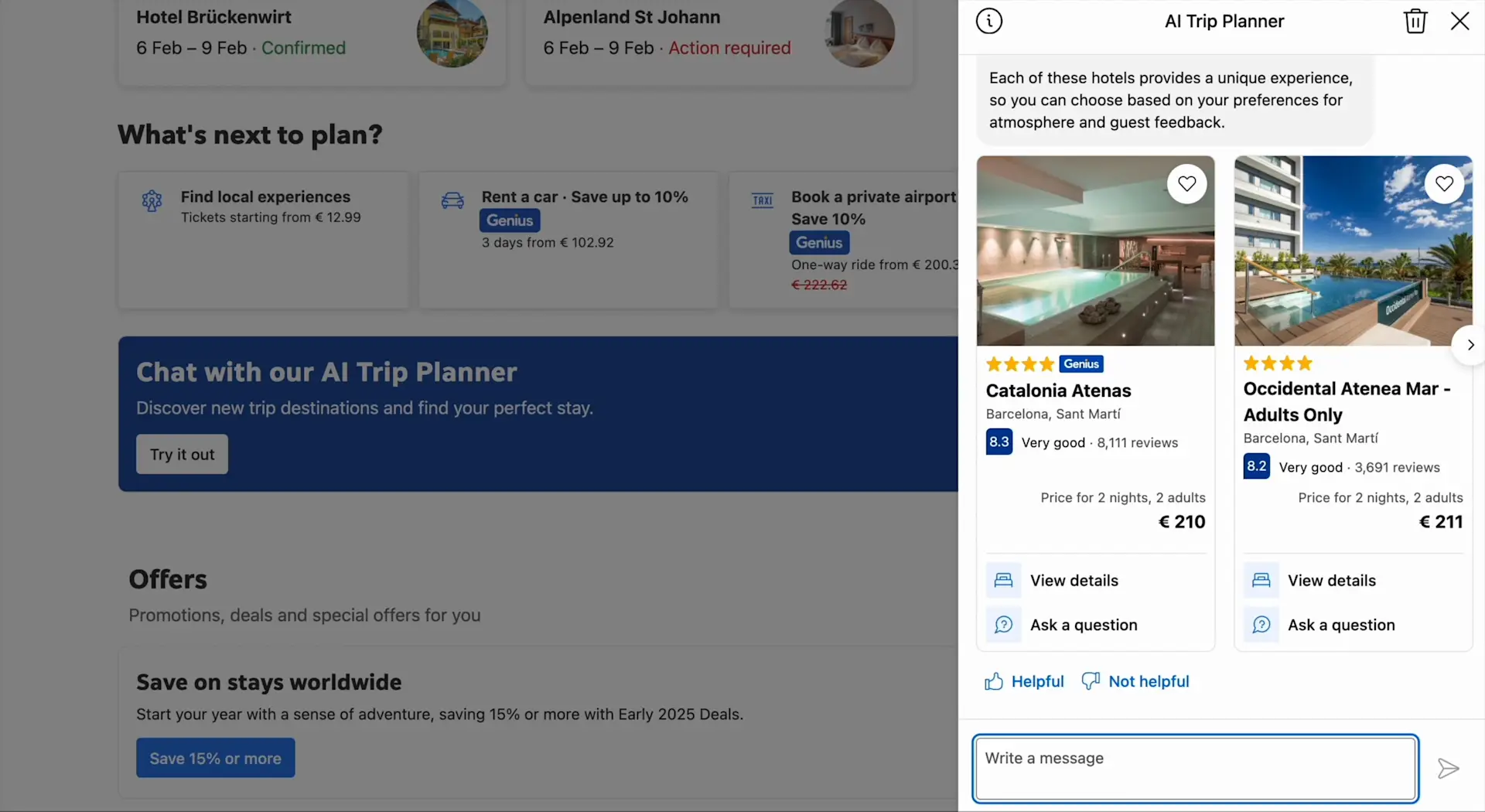

Sedangkan TPU 81untuk inferensi difokuskan pada kecepatan respons saat berinteraksi dengan pengguna. Chip ini dirancang untuk menjalankan model AI secara efisien dalam skenario real-time seperti asisten digital.

Inovasi yang diterapkan pada sistem inferensi antara lain:

- Kapasitas memori lebih besar untuk menangani konteks dan data aktif

- Penggunaan prosesor internal berbasis efisiensi energi

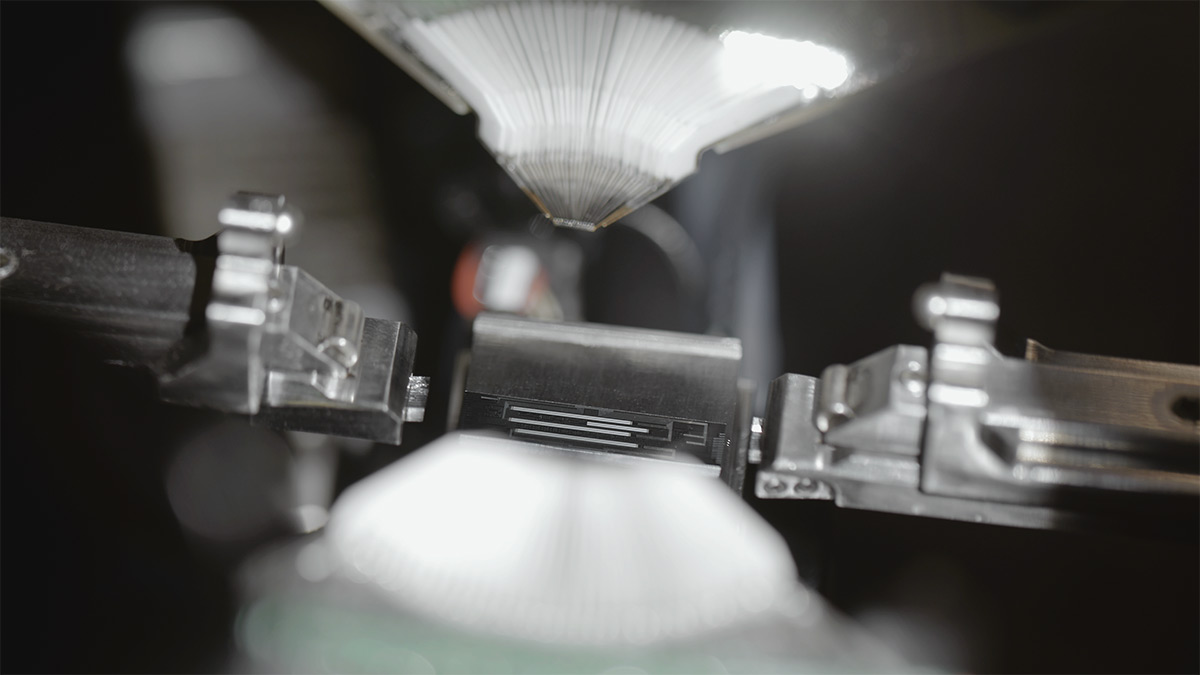

- Arsitektur interkoneksi baru untuk mempercepat transfer data antar node

Kedua jenis chip ini menggunakan teknologi pendingin cair generasi terbaru untuk menjaga stabilitas suhu. Pendekatan ini memungkinkan pusat data meningkatkan kapasitas komputasi secara signifikan tanpa lonjakan konsumsi energi.