(Source: NVIDIA)

Menyebarkan AI yang kuat membutuhkan proses yang rumit, meliputi kurasi varian model, adaptasi untuk mengelola data input dan output, serta kuantisasi untuk mengurangi kebutuhan VRAM. Model-model harus dikonversi agar bekerja dengan perangkat lunak backend inferensi yang dioptimalkan dan dihubungkan ke API AI yang baru. Proses ini sering kali terbatas pada spesialis AI dan pengembang dengan pengetahuan infrastruktur yang maju.

Model penyuntingan gambar FLUX.1 Kontext dari Black Forest Labs sekarang tersedia sebagai NVIDIA NIM microservice. Layanan mikro NIM ini menyederhanakan proses yang rumit, memungkinkan alur kerja AI generatif yang lebih cepat, dan dioptimalkan untuk PC RTX AI.

Keunggulan FLUX.1

Model FLUX.1 Kontext adalah model generatif open-weight yang dibangun khusus untuk penyuntingan gambar. Model ini memiliki proses generasi terpandu langkah demi langkah yang memudahkan pengguna untuk mengontrol evolusi gambar, baik saat menyempurnakan detail kecil maupun saat mengubah seluruh adegan. Karena model ini menerima input teks dan gambar, pengguna dapat dengan mudah mereferensikan konsep visual dan memandunya secara alami.

NVIDIA dan Black Forest Labs bekerja sama untuk mengkuantisasi FLUX.1 Kontext, yang berhasil mengurangi ukuran model dari 24GB menjadi 12GB untuk FP8 dan 7GB untuk FP4. Titik pemeriksaan FP8 dioptimalkan untuk GPU GeForce RTX 40 Series, yang memiliki akselerator FP8, sementara titik pemeriksaan FP4 dioptimalkan untuk GPU GeForce RTX 50 Series.

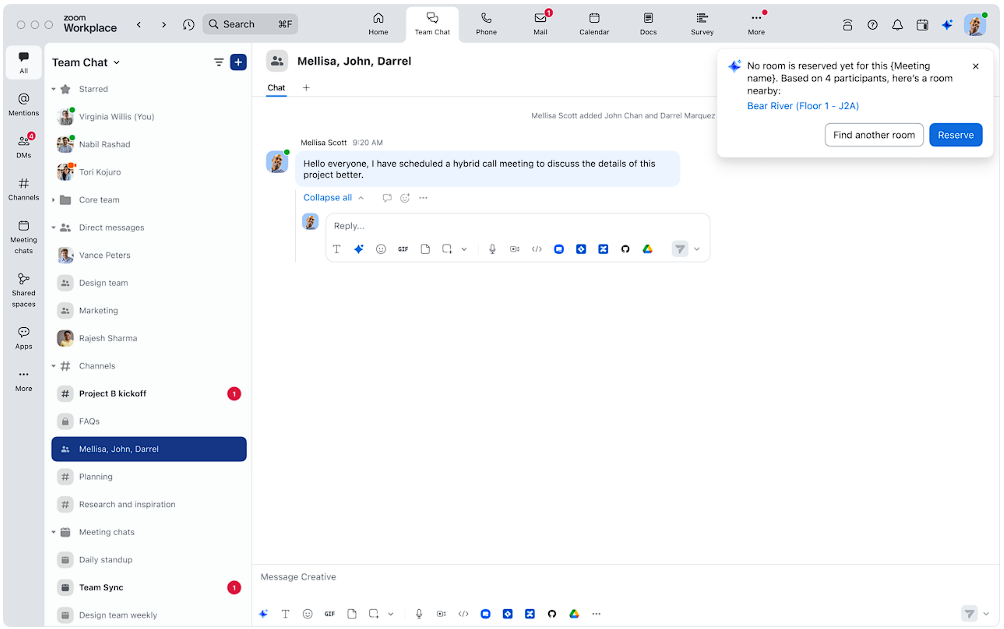

Layanan mikro FLUX.1 Kontext ini menyediakan file-file yang sudah dikemas dan dioptimalkan, siap untuk diunduh dengan satu klik melalui ComfyUI NIM nodes. Hal ini membuat model lebih mudah diakses oleh pengguna. Dengan begitu, penghematan waktu dapat dicapai dengan kinerja yang lebih baik.

Pengoptimalan NVIDIA TensorRT sebuah kerangka kerja untuk mengakses Tensor Cores pada GPU NVIDIA RTX memberikan akselerasi lebih dari 2 kali dibandingkan dengan menjalankan model asli BF16 dengan PyTorch. Peningkatan kinerja yang luar biasa ini sebelumnya terbatas pada spesialis AI dan pengembang dengan pengetahuan infrastruktur yang maju. Dengan layanan mikro NIM, bahkan para penggemar dapat mencapai penghematan waktu ini dengan kinerja yang lebih baik.