OpenAI menjelaskan bagaimana melindungi AI agent dari prompt injection yang kini semakin mirip social engineering, dengan pendekatan pembatasan aksi berisiko, Safe Url, dan sandbox pada ChatGPT.

AI agent kini mampu menjelajahi web, mengambil informasi, dan menjalankan tindakan atas nama pengguna. Namun, kemampuan tersebut juga membuka jalur baru bagi penyerang untuk memanipulasi sistem melalui konten eksternal yang dirancang khusus.

OpenAI menjelaskan bahwa serangan ini dikenal sebagai prompt injection, yaitu instruksi yang ditempatkan di konten luar untuk mendorong model melakukan sesuatu yang tidak diminta pengguna. Dalam praktiknya, bentuk serangan yang paling efektif kini semakin menyerupai social engineering, bukan sekadar perintah berbahaya yang terlihat jelas.

Karena itu, pertahanan tidak cukup hanya mengandalkan penyaringan input. Menurut OpenAI, sistem agen harus dirancang agar dampak manipulasi tetap terbatas, bahkan ketika serangan berhasil memengaruhi model.

OpenAI menganalogikan AI agent seperti petugas layanan pelanggan yang bekerja di lingkungan berisiko. Sama seperti agen manusia, AI agent perlu diberi batas wewenang dan kontrol sistem agar tidak mudah disalahgunakan oleh pihak luar.

Kontrol ChatGPT Dirancang untuk Membatasi Risiko

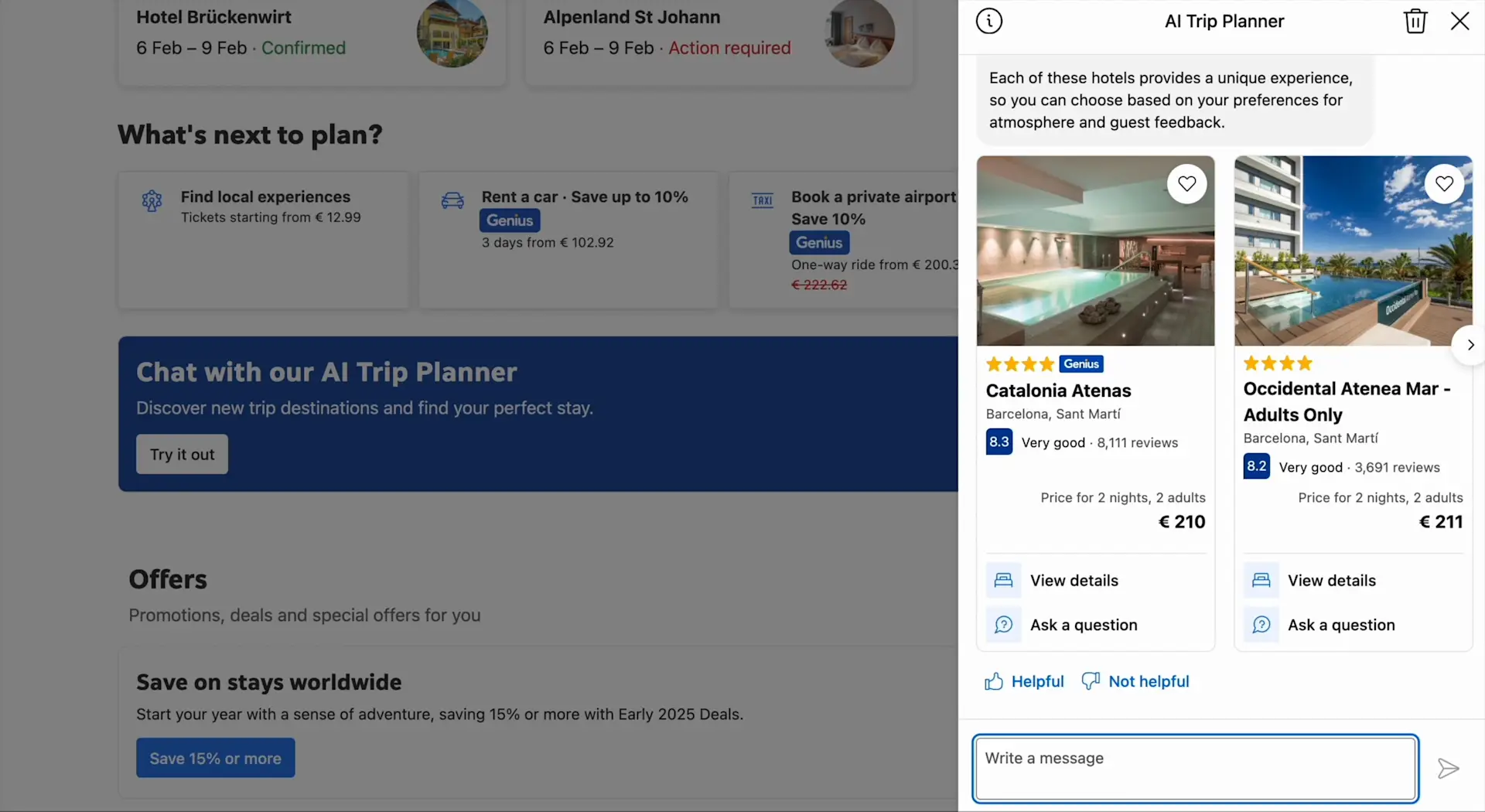

Di ChatGPT, OpenAI menggabungkan pendekatan social engineering dengan teknik keamanan tradisional seperti source-sink analysis. Dalam kerangka ini, serangan menjadi berbahaya ketika konten eksternal yang tidak tepercaya terhubung dengan aksi sensitif seperti mengirim data ke pihak ketiga, membuka tautan, atau memakai tool tertentu.

Salah satu mitigasi penting yang dipakai adalah Safe Url. Mekanisme ini dirancang untuk mendeteksi ketika informasi yang dipelajari asisten dari percakapan berpotensi dikirim ke pihak ketiga, lalu sistem akan meminta konfirmasi pengguna atau memblokir tindakan tersebut.

OpenAI juga menyebut pendekatan serupa diterapkan pada navigasi dan bookmark di Atlas serta pencarian dan navigasi di Deep Research. Sementara itu, ChatGPT Canvas dan ChatGPT Apps menjalankan aplikasi fungsional di dalam sandbox yang mampu mendeteksi komunikasi tak terduga dan meminta persetujuan pengguna sebelum tindakan berisiko dilakukan.