Akamai memperluas infrastruktur AI global dengan ribuan NVIDIA Blackwell GPU untuk menghadirkan layanan inferensi AI yang lebih cepat, hemat biaya, dan dekat dengan pengguna melalui jaringan edge cloud.

Banyak organisasi masih menghadapi hambatan besar saat ingin mengimplementasikan AI dalam skala besar. Salah satu tantangan utama adalah latensi atau keterlambatan pengiriman data ketika model AI dijalankan dari pusat data berbeda lokasi yang jauh. Kondisi ini membuat banyak aplikasi AI sulit digunakan pada situasi yang membutuhkan respons instan di lapangan.

Akamai menjawab kebutuhan pasar dengan memperkuat infrastruktur komputasi awannya. Ribuan GPU NVIDIA Blackwell akan dipakai di jaringan cloud terdistribusi milik Akamai yang tersebar di lebih dari 4.400 lokasi global. Strategi ini memungkinkan beban kerja AI diproses lebih dekat dengan pengguna sehingga mempercepat respons sistem.

Platform ini dirancang untuk mendukung tahap inferensi, yaitu fase ketika model AI mulai menghasilkan keputusan atau prediksi berdasarkan data yang diterima. Perusahaan dapat menjalankan aplikasi AI secara real-time tanpa harus bergantung pada pusat data yang jauh dengan memindahkan pemrosesan ke jaringan edge cloud.

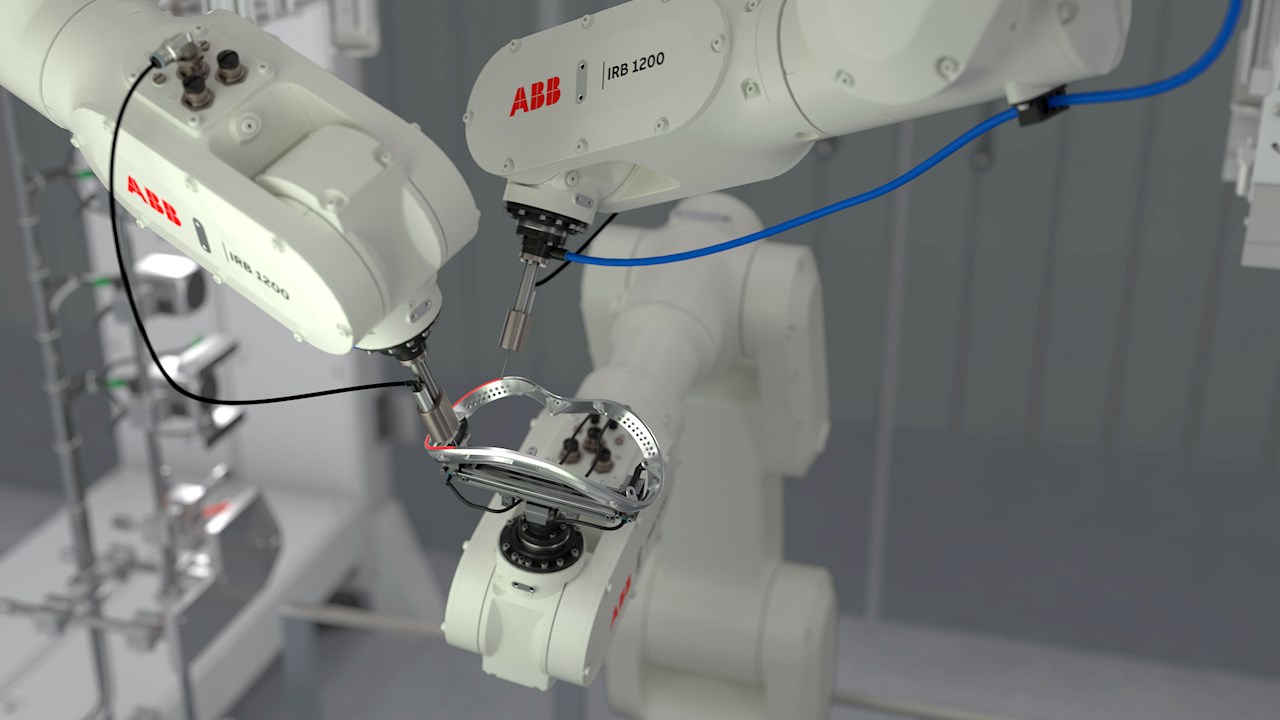

Pendekatan ini membuka peluang baru bagi berbagai sektor industri. Teknologi AI dapat digunakan pada sistem yang membutuhkan keputusan instan seperti robot medis, kendaraan otonom, hingga sistem deteksi penipuan yang memerlukan analisis data secara langsung.

Infrastruktur Edge AI Kurangi Biaya dan Latensi

Implementasi GPU NVIDIA Blackwell pada jaringan edge cloud Akamai menghadirkan beberapa fungsi utama bagi pengembang dan perusahaan.

- Inferensi AI Berkinerja Tinggi

Sistem menjalankan beban kerja AI pada klaster GPU khusus sehingga mampu menghasilkan respons dengan latensi rendah dan performa yang stabil. - Fine-Tuning Model Secara Lokal

Model bahasa besar atau LLM dapat disesuaikan menggunakan data lokal sehingga membantu menjaga privasi data sekaligus memenuhi regulasi wilayah. - Penyempurnaan Model Berbasis Data Perusahaan

Organisasi dapat mengoptimalkan model AI menggunakan data internal untuk meningkatkan akurasi dalam berbagai kebutuhan operasional.

“Sementara hyperscalers terus mendorong batas-batas pelatihan AI, Akamai fokus pada memenuhi tuntutan unik era inferensi,” kata Adam Karon, Chief Operating Officer and General Manager, Cloud Technology Group, Akamai. “AI factory terpusat tetap esensial untuk membangun model, tetapi membawa model-model tersebut ke skala besar memerlukan sistem saraf terdesentralisasi. Dengan mendistribusikan komputasi yang dioptimalkan untuk inferensi di seluruh jaringan global kami, Akamai tidak hanya menambah kapasitas. Kami menyediakan skala dengan latensi minimal yang diperlukan untuk membawa AI dari laboratorium ke sudut jalan dan tempat tidur rumah sakit di mana pekerjaan dilakukan, di mana data berada, dan di mana ROI terwujud.”