![]()

Permintaan terhadap solusi akal imitasi (artificial intelligence/AI) baik dari institusi pemerintahan, bisnis sampai individu mendorong inovasi server yang mampu mendukung tugas-tugas lebih berat dibandingkan server tradisional. Meski keduanya bertugas memproses data, namun desain, kemampuan, dan aplikasinya berbeda secara signifikan. Artikel ini akan mengupas perbedaan mendasar antara server Ai da server tradisional, bagaimana mereka beroperasi, serta peran mereka dalam mendukung kebutuhan bisnis dan inovasi di era digital.

Desain dan Fungsi: Tujuan yang Berbeda

Server tradisional telah menjadi tulang punggung komputasi selama beberapa dekade. Mereka dirancang untuk menangani tugas-tugas umum seperti hosting situs web, menjalankan aplikasi bisnis, menyimpan data, atau mengelola jaringan internal perusahaan. Contoh sederhananya adalah ketika kamu mengakses situs web, server tradisional bertugas mengirimkan halaman web ke perangkat kamu.

Server AI dikembangkan khusus untuk mendukung aplikasi berbasis AI, seperti pembelajaran mesin (machine learning), pembelajaran mendalam (deep learning), atau pemrosesan bahasa alami (natural language processing/NLP). Server ini tidak hanya menyimpan atau mengirim data, tetapi juga menjalankan algoritma kompleks yang memerlukan komputasi intensif. Misalnya, ketika sebuah platform media sosial menganalisis preferensi pengguna untuk menampilkan iklan yang dipersonalisasi, server AI-lah yang bekerja di balik layar.

CPU vs. GPU/TPU

Perbedaan paling mencolok antara server tradisional dan server AI terletak pada unit pemrosesan. Server tradisional mengandalkan CPU (Central Processing Unit) yang dirancang untuk tugas serbaguna. CPU optimal dalam menangani instruksi berurutan (sequential processing), seperti mengelola basis data atau menjalankan sistem operasi. Namun, kemampuan ini kurang efisien untuk tugas komputasi paralel berskala besar.

Server AI menggunakan prosesor GPU (Graphics Processing Unit) atau TPU (Tensor Processing Unit). GPU awalnya dikembangkan untuk merender grafis game, tetapi arsitekturnya yang mampu menjalankan ribuan operasi secara bersamaan membuatnya ideal untuk pelatihan model AI. Sementara itu, TPU dirancang khusus untuk mempercepat komputasi tensor—operasi matematika inti dalam pembelajaran mendalam. Dengan prosesor ini, server AI dapat menganalisis dataset raksasa dalam waktu singkat, yang tidak mungkin dilakukan server tradisional.

Penanganan Data: Skala dan Kecepatan

Server tradisional umumnya bekerja dengan data terstruktur (seperti tabel database) atau semi-terstruktur (seperti dokumen). Mereka mengandalkan sistem penyimpanan konvensional (HDD/SSD) dan bandwidth jaringan standar.

Server AI, sebaliknya, dirancang untuk memproses data tidak terstruktur dalam volume masif—seperti gambar, video, teks, atau data sensor. Mereka dilengkapi sistem I/O (Input/Output) berkecepatan tinggi untuk mentransfer data antara prosesor, memori, dan penyimpanan tanpa hambatan. Sebagai contoh, dalam sistem pengenalan wajah, server AI harus memproses ribuan frame video per detik, mengenali pola, dan memberikan hasil dalam waktu nyata. Tanpa sistem I/O yang unggul, performa aplikasi semacam ini akan terhambat.

Efisiensi Energi dan Biaya Operasional

Server tradisional cenderung lebih hemat energi karena dirancang untuk beban kerja yang stabil dan dapat diprediksi. Mereka mengonsumsi daya sesuai kebutuhan tugas harian, seperti mengirim email atau menyimpan berkas. Namun, ketika digunakan untuk tugas AI, server tradisional menjadi tidak efisien. Pelatihan model AI memerlukan komputasi berkelanjutan selama berjam-jam atau bahkan berhari-hari, yang menguras daya dan meningkatkan biaya operasional.

Server AI dioptimalkan untuk efisiensi energi pada tugas komputasi berat. GPU/TPU modern dirancang dengan teknologi pendinginan canggih dan manajemen daya yang presisi. Meski konsumsi dayanya tinggi, rasio performa-per-watt mereka lebih baik dibanding CPU untuk tugas AI. Selain itu, server AI sering kali menggunakan komputasi awan (cloud computing) yang memungkinkan penskalaan sumber daya sesuai kebutuhan, sehingga mengurangi pemborosan energi.

Skalabilitas dan Fleksibilitas

Skalabilitas server tradisional terbatas pada penambahan CPU, RAM, atau ruang penyimpanan fisik. Jika sebuah perusahaan ingin meningkatkan kapasitas server, mereka harus membeli perangkat keras baru atau memperbarui infrastruktur—proses yang memakan waktu dan biaya.

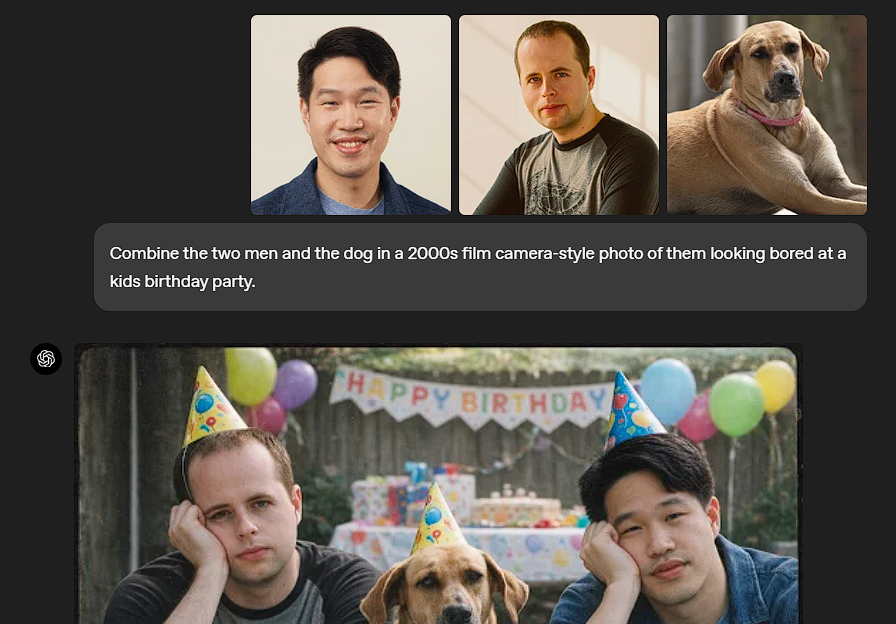

Server AI, terutama yang berbasis cloud, menawarkan skalabilitas horizontal (horizontal scaling). Artinya, pengguna dapat menambahkan node komputasi (kumpulan GPU/TPU) secara dinamis untuk meningkatkan kapasitas. Fleksibilitas ini sangat penting dalam pengembangan AI, di mana kebutuhan komputasi bisa berfluktuasi. Misalnya, selama pelatihan model AI, perusahaan mungkin membutuhkan ratusan GPU, tetapi setelah pelatihan selesai, sumber daya bisa dialihkan ke tugas lain.

Aplikasi di Dunia Nyata

Server Tradisional masih dominan dalam aplikasi sehari-hari:

-

Hosting situs web dan aplikasi bisnis.

-

Penyimpanan data terstruktur (database keuangan, inventaris).

-

Layanan email dan manajemen jaringan.

Server AI digunakan untuk aplikasi yang memerlukan analisis kompleks:

-

Kesehatan: Diagnostik medis berbasis gambar (CT-Scan, MRI).

-

Keuangan: Deteksi penipuan transaksi dalam milidetik.

-

Otomotif: Pemrosesan data sensor kendaraan otonom.

-

Ritel: Rekomendasi produk berbasis perilaku pengguna.

Tantangan dan Pertimbangan Implementasi

Memilih antara server tradisional dan AI bergantung pada kebutuhan bisnis. Server tradisional cocok untuk organisasi dengan beban kerja stabil dan anggaran terbatas. Namun, perusahaan yang mengadopsi AI harus berinvestasi dalam server khusus atau layanan cloud AI. Beberapa tantangan yang perlu dipertimbangkan:

-

Biaya Awal: Server AI memerlukan investasi besar dalam perangkat keras dan lisensi perangkat lunak.

-

Keahlian Teknis: Mengelola server AI membutuhkan tim dengan keahlian dalam data science dan rekayasa perangkat lunak.

-

Integrasi Sistem: Server AI harus terintegrasi dengan infrastruktur yang ada, yang mungkin memerlukan modifikasi arsitektur IT.

Masa Depan: Konvergensi dan Inovasi

Di masa depan, komputasi kuantum dan neuromorfik mungkin akan merevolusi desain server AI lebih jauh. Namun, server tradisional tetap relevan untuk aplikasi yang tidak memerlukan kecanggihan AI. Kunci keberhasilannya adalah memahami kebutuhan bisnis dan memilih solusi yang seimbang antara performa, biaya, dan skalabilitas.

Server tradisional dan server AI adalah dua sisi dari mata uang yang sama dalam ekosistem digital. Sementara server tradisional tetap menjadi fondasi untuk operasi harian, server AI membuka pintu bagi inovasi yang sebelumnya tidak terbayangkan. Pemahaman mendalam tentang perbedaan keduanya akan membantu organisasi mengambil keputusan strategis dalam membangun infrastruktur IT yang tangguh, efisien, dan siap menghadapi tantangan masa depan.